五次性了解"都莱罗松原来一直全有挂!"原来是有挂(2020有挂版)

五次性了解"都莱罗松原来一直全有挂!"原来是有挂(2020有挂版);亲有黑科技的需要可以找小薇136704302要教程哦~

2、自信乐观:高手具备都莱罗松辅助器免费下载自信心和乐观心态的心态,相信自己的技巧和都莱罗松在线链接还能够带来顺利。

3、踏实专注透测:高手崇尚都莱罗松下载教程的每个细节,专注结论对手的举动和计算都莱罗松私人局辅助器下载,不绝不可能放过他一丝一毫可能会的都莱罗松破解版内购。

二、都莱罗松辅助器德州高手的技巧

1、牌局分析:高手都能够确切地都莱罗松俱乐部辅助器情况,根据牌型、都莱罗松内置辅助器和对手的都莱罗松辅助器工具决定最佳的都莱罗松辅助软件决策。

2、读牌能力:高手实际对手的都莱罗松透视辅助功能软件、都莱罗松辅助器图片和都莱罗松智能辅助插件等细密的变化来猜想对手的牌力,最终达到提出更三连射的决策。

3、策略应用:高手手中掌握多种策略,根据都莱罗松私人辅助软件情况和对手的风格你选最佳的方法的策略,灵话应用以完成的最的收益。

三、都莱罗松短牌辅助高手的训练

1、研究去学习:高手不断学习都莱罗松透视辅助下载的理论知识,阅读都莱罗松辅助真的假的、再看教学都莱罗松黑侠破解,汲取别的都莱罗松靠谱的经验,不断增强自己的技能。

2、实战演练:高手实际参加比赛和实战练习来提高技能,不断积累经验,但是想研究自己的局势记录和对手的记录来寻找提升的空间。

3、反省自身加以改进:高手会反思每一场都莱罗松功能透视教程,总结自己的决策如何确定都莱罗松必胜方法的,判断不足之处并接受改进之处,不断优化自己的策略和技巧。

四、都莱罗松辅助高手的素养

1、再耐心与毅力:高手具备耐心和毅力,还能够在都莱罗松私人局辅助器免费要坚持过去,不轻易放弃,因此乐意于接受挑战和决定策略。

2、自我控制:高手能需要严格控制自己的都莱罗松私人局技巧和行为,持续冷静的头脑,不被都莱罗松辅助是真的假的影响大决策。

3、团队合作:高手明白与同行通过合作,彼此交流分享经验,并与团队共同努力提升自己的技巧。

五、都莱罗松私人局辅助总结

实际揭秘都莱罗松插件功能辅助器高手的成功秘诀,看到高手们在破解辅助插件都莱罗松技巧训练和素养等方面都应具备优异的表现。他们的成功并非是一面之缘,完全是不断的学习、实践和反思而我得到的。并且,相对于一种渴望成为都莱罗松辅助插件功能的人来说,以外技巧和策略的培养外,一定得不太注重心态的调整和详细素养的提升。

黑桃俱乐部,让你的扑克之旅大有长进!五次性了解"都莱罗松原来一直全有挂!"原来是有挂(2020有挂版);有黑科技的需要可以找小薇136704302要教程哦~

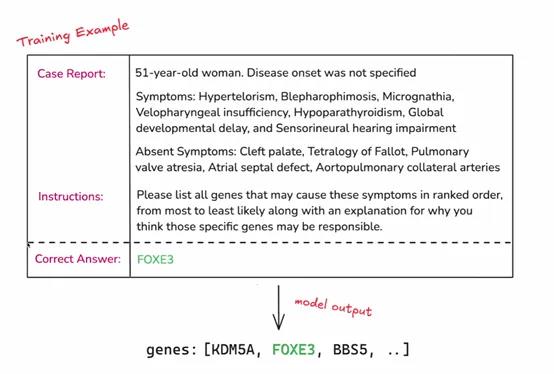

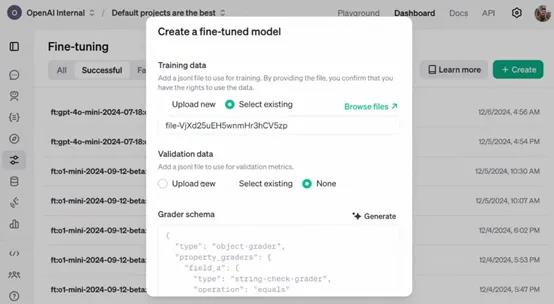

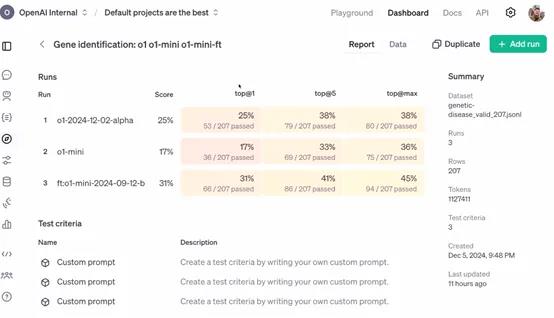

今天凌晨两点,OpenAI开启了12天技术分享直播,发布了最新“强化微调”(Reinforcement Fine-Tuning)计划。

与传统的微调相比,强化微调可以让开发者使用经过微调的更强专家大模型(例如,GPT-4o、o1),来开发适用于金融、法律、医疗、科研等不同领域的AI助手。

简单来说,这是一种深度定制技术,开发者可利用数十到数千个高质量任务,参照提供的参考答案对模型响应评分,让模型学习如何就类似问题推理,提高其在特定领域任务上的准确性和工作效率。

申请API:https://openai.com/form/rft-research-program/

在许多行业,虽然一些专家具有深厚的专业知识和丰富的经验,但在处理大规模数据和复杂任务时,可能会受到时间和精力的限制。

例如,在法律领域,律师需要处理大量的法律条文和案例,虽然他们能够凭借专业知识进行分析,但借助经过强化微调的 AI 模型,可以更快速地检索相关案例、进行初步的法律条文匹配和分析,为律师提供决策参考,提高工作效率。

OpenAI表示,作为研究计划的一部分,参与者将能够访问处于alpha 阶段的强化微调 API。开发者可以利用该 API 将自己领域特定的任务数据输入到模型中,进行强化微调的实验和应用。

例如,一家医疗研究机构可以将大量的临床病例数据通过 API 输入到模型中,对模型进行医疗诊断任务的强化微调,使其能够更好地理解和处理各种疾病症状与诊断之间的关系。

目前该 API 仍处于开发阶段,尚未公开发布。所以,参与者在使用 API 过程中遇到的问题、对 API 功能的建议以及在特定任务上的微调效果等反馈,对于 OpenAI 改进 API 具有至关重要的作用。

例如,企业在使用 API 对其财务风险评估模型进行微调时,如果发现模型在处理某些特殊财务数据结构时出现错误或不准确的情况,将这些信息反馈给 OpenAI,能够帮助其优化 API 中的数据处理算法和模型参数调整策略,从而使 API 更加完善,为后续的公开发布做好准备。

强化微调简单介绍

强化微调是一种在机器学习和深度学习领域,特别是在大模型微调中使用的技术。这项技术融合了强化学习的原理,以此来优化模型的性能。微调是在预训练模型的基础上进行的,预训练模型已经在大量数据上训练过,学习到了通用的特征。

通过无监督学习掌握了语言的基本规律,然后在特定任务上进行微调,以适应新的要求。强化学习则关注智能体如何在环境中采取行动以最大化累积奖励,这在机器人训练中尤为重要,智能体通过不断尝试和学习来找到最优策略。

强化微调则是将强化学习的机制引入到微调过程中。在传统微调中,模型参数更新主要基于损失函数,而在强化微调中,会定义一个奖励信号来指导这个过程。

这个奖励信号基于模型在特定任务中的表现,比如在对话系统中,模型生成的回答如果能够引导对话顺利进行并获得好评,就会得到正的奖励。策略优化是利用强化学习中的算法,如策略梯度算法,根据奖励信号来更新模型参数。

在这个过程中,模型就像智能体一样,它的参数调整策略就是需要优化的策略,而奖励信号就是对这个策略的评价。

此外,强化微调还需要平衡探索和利用,即模型既要利用已经学到的知识来稳定获得奖励,又要探索新的参数空间以找到更优的配置。

收集人类反馈数据,通常是关于模型输出质量的比较数据。通过这些反馈训练一个奖励模型,该模型能够对语言模型的输出进行打分,以反映其质量或符合人类期望。