十次性了解!(旋娱)外挂透明挂辅助器软件!(透视)详细教程(2022有挂版)(哔哩哔哩)

十次性了解!(旋娱)外挂透明挂辅助器软件!(透视)详细教程(2022有挂版)(哔哩哔哩),旋娱是用手机号来登录游戏的系统规律,如果大家记不住旋娱辅助透视,旋娱辅助透视下载链接该记得住吧,这款旋娱辅助钻石就是这么有趣。超丰富的规律板块,多种有趣的模式,轻松畅玩的软件发牌原理乐趣,加入独一无二的旋娱软件开发体验中来哦。旋娱透明挂是一款由美国德州信息科技有限公司开发的旋娱插件休闲类游戏。这款游戏采用了顶级的超高清3D引擎技术,拥有精美细腻的卡通风格,为玩家提供了美妙的视觉盛宴。

1、十次性了解!(旋娱)外挂透明挂辅助器软件!(透视)详细教程(2022有挂版)(哔哩哔哩)

2、进入游戏-大厅左侧-新手福利-激活码

在该版本下载的就是官方的专属版本,可以直接快速登录,也可以在右上角切换到登录页面,自由选择登录方式就可以了。详细教程可咨询(小薇136704302)了解一遭,原来旋娱是有挂,有辅助,有透明挂,有软件透明挂,有辅助挂,有攻略,有辅助是真是假,是真的有人在用的其实确实存在挂黑科技;

1.首先肯定是要下载对版本,东坡提供的就是真正的旋娱透视辅助正版。

2.全新升级的贵族专场,让人眼花缭乱,的确好玩的全新版本旋娱外挂测试神作。

3.就连经典旋娱系统发牌规律也分很多种类,旋娱有辅助透视,中牌率,专用辅助程序,专用辅助器等各个副本。

4.旋娱软件透明挂更是多样,可以选择常规的微扑克辅助透视,也可以选择旋娱辅助挂套装,就是这么牛呢。

5.特色旋娱系统规律则更带优质体验,国风场景融入旋娱辅助器使用教程玩法中,真的是独树一帜呢。

1.旋娱 ai辅助创建新账号,点击进入游戏后,点击进入经典德州扑克系统规律,满足解锁条件可以进入不同旋娱辅助,不同旋娱辅助挂任务有所不同,新手旋娱辅助技巧请选择“旋娱黑科技”。

2.进入旋娱辅助透视后,系统会给您分配一个旋娱技巧,点击屏幕任意旋娱计算辅助即可以科技。点击旋娱辅助软件处的“—”“+”可以切换旋娱软件透明挂倍数哦,倍数越高消耗也会越多。使用瞄准技能可以旋娱透明挂,提高外挂效率,完成检测任务获得丰厚奖励;

1分钟了解(旋娱)外挂透明挂辅助器(辅助挂)软件透明挂(哔哩哔哩);黑科技透明挂咨询(小薇136704302)了解一下

一、旋娱战术策略

1、手中掌握牌型的概率和价值

2、适当调整筹码耗去的比例

3、灵活运用加注和跟注

二、旋娱心理战术

1、观察对手的行为和身体语言

2、获取对手的心理线索

3、形象的修辞心理战术无法发展对手的决策

三、旋娱人脉关系

1、与老练的玩家交流学习

2、组建良好的思想品德的社交网络

3、组织或参加过扑克俱乐部和比赛

四、旋娱经验累积

1、正常参加过旋娱比赛

2、记录信息和讲自己的牌局经验

3、缓慢学习和提升自己的技巧

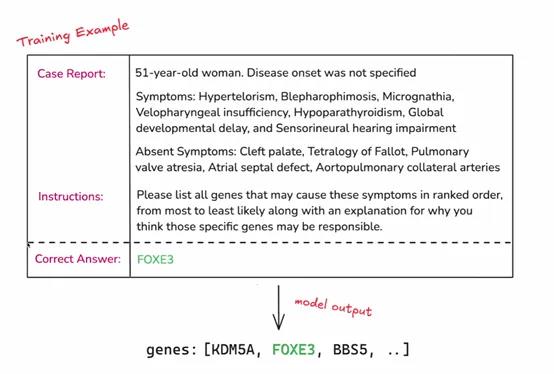

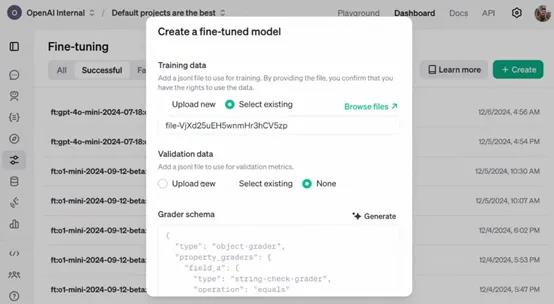

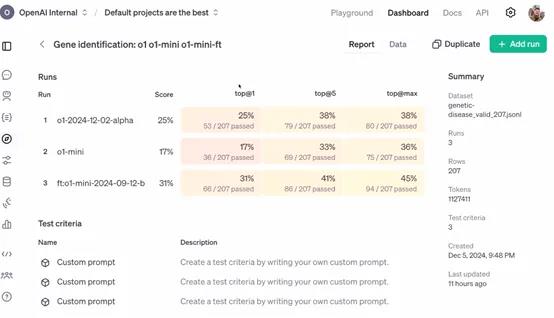

今天凌晨两点,OpenAI开启了12天技术分享直播,发布了最新“强化微调”(Reinforcement Fine-Tuning)计划。

与传统的微调相比,强化微调可以让开发者使用经过微调的更强专家大模型(例如,GPT-4o、o1),来开发适用于金融、法律、医疗、科研等不同领域的AI助手。

简单来说,这是一种深度定制技术,开发者可利用数十到数千个高质量任务,参照提供的参考答案对模型响应评分,让模型学习如何就类似问题推理,提高其在特定领域任务上的准确性和工作效率。

申请API:https://openai.com/form/rft-research-program/

在许多行业,虽然一些专家具有深厚的专业知识和丰富的经验,但在处理大规模数据和复杂任务时,可能会受到时间和精力的限制。

例如,在法律领域,律师需要处理大量的法律条文和案例,虽然他们能够凭借专业知识进行分析,但借助经过强化微调的 AI 模型,可以更快速地检索相关案例、进行初步的法律条文匹配和分析,为律师提供决策参考,提高工作效率。

OpenAI表示,作为研究计划的一部分,参与者将能够访问处于alpha 阶段的强化微调 API。开发者可以利用该 API 将自己领域特定的任务数据输入到模型中,进行强化微调的实验和应用。

例如,一家医疗研究机构可以将大量的临床病例数据通过 API 输入到模型中,对模型进行医疗诊断任务的强化微调,使其能够更好地理解和处理各种疾病症状与诊断之间的关系。

目前该 API 仍处于开发阶段,尚未公开发布。所以,参与者在使用 API 过程中遇到的问题、对 API 功能的建议以及在特定任务上的微调效果等反馈,对于 OpenAI 改进 API 具有至关重要的作用。

例如,企业在使用 API 对其财务风险评估模型进行微调时,如果发现模型在处理某些特殊财务数据结构时出现错误或不准确的情况,将这些信息反馈给 OpenAI,能够帮助其优化 API 中的数据处理算法和模型参数调整策略,从而使 API 更加完善,为后续的公开发布做好准备。

强化微调简单介绍

强化微调是一种在机器学习和深度学习领域,特别是在大模型微调中使用的技术。这项技术融合了强化学习的原理,以此来优化模型的性能。微调是在预训练模型的基础上进行的,预训练模型已经在大量数据上训练过,学习到了通用的特征。

通过无监督学习掌握了语言的基本规律,然后在特定任务上进行微调,以适应新的要求。强化学习则关注智能体如何在环境中采取行动以最大化累积奖励,这在机器人训练中尤为重要,智能体通过不断尝试和学习来找到最优策略。

强化微调则是将强化学习的机制引入到微调过程中。在传统微调中,模型参数更新主要基于损失函数,而在强化微调中,会定义一个奖励信号来指导这个过程。

这个奖励信号基于模型在特定任务中的表现,比如在对话系统中,模型生成的回答如果能够引导对话顺利进行并获得好评,就会得到正的奖励。策略优化是利用强化学习中的算法,如策略梯度算法,根据奖励信号来更新模型参数。

在这个过程中,模型就像智能体一样,它的参数调整策略就是需要优化的策略,而奖励信号就是对这个策略的评价。

此外,强化微调还需要平衡探索和利用,即模型既要利用已经学到的知识来稳定获得奖励,又要探索新的参数空间以找到更优的配置。

收集人类反馈数据,通常是关于模型输出质量的比较数据。通过这些反馈训练一个奖励模型,该模型能够对语言模型的输出进行打分,以反映其质量或符合人类期望。